Veréis, no soy ningún experto en robótica, mis conocimientos de ingenierÃa y electrónica dejan bastante que desear, asà que es posible que lo que suelte a partir de aquà no sean más que un gran conjunto de chorradas futuribles de ciencia-ficción.

Hace unos años un amigo y yo quisimos hacer un robot, pero no sabÃamos ni por donde empezar ni qué querÃamos que el bichejo hiciese, cuando empiezas a programar sabes que lo que hagas, ha de tener un fin. Hacer un programa que haga… Pues con los robots igual.

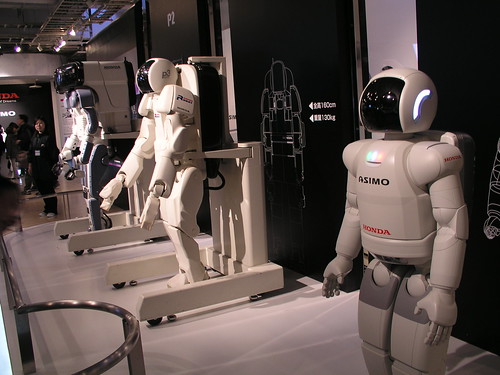

Ahora que los autómatas humanoides empiezan a no llamarnos tanto la atención, que los empezamos a asimilar fuera de pelÃculas del tipo Terminator, me cuestiono su fiabilidad.

Un autómata es una máquina diseñada para facilitar la vida a los humanos pero que requiere de la interacción de éstos, supuestamente un buen robot deberÃa poder escoger, elegir qué acciones hacer en base a lo que esté programado y sus circunstancias. Kevin Mitnick nos enseñó que la forma más rápida y eficaz de obtener cualquier dato (en su caso, hackear) era preguntando por ese dato en persona. Porque una persona es más vulnerable que una máquina y cualquiera que tenga una palabrerÃa ligera o sepa manejar los sentimientos de alguien podrá franquear la razón de éste último y aprovecharse de esta vulnerabilidad, un bug de carne y hueso, vaya. Todos hemos oÃdo hablar de la ingenierÃa social, ¿no? Bueno, tal vez alguno se escape. Es que es un tema que siempre me ha apasionado.

A raÃz de los avances en robótica (y dando por hecho que se cumplirán las tres leyes ficticias y que no serán expuestos a males lógicos como virus, troyanos, gusanos, etc) es fácil pensar que otorgar emociones a una máquina podrÃa ayudar a los humanos, algo asà como Tele-amigos (o Twitter), no tengo con quién hablar, pues me compro una Chobit.

Bueno, según la primera ley un robot nunca deberá dañar a un humano. Yo esto lo entiendo como algo fÃsico, no moral, es decir, que su brazo con lanzallamas no se dispare jamás contra una abuelita cruzando la calle.Teniendo claro que lo que nos impulsa a hacer algo grandioso, romántico, crÃtico o totalmente estúpido en la mayorÃa de los casos son las emociones -ya que los humanos no estamos programados, disponemos de libre albedrÃo a no ser que Matrix diga lo contrario- también un robot podrÃa.

Y como tal, un humanoide con sentimientos serÃa (recordemos los primeros párrafos) una máquina vulnerable. Por la misma regla, un robot suficientemente bien programado podrÃa utilizar esas emociones para vulnerar a un humano y «hackearlo». SÃ, resulta estúpido. Pero lo veo factible. No quiero decir que ahora mismo, que apenas pueden subir unos peldaños, podamos hacerlos llorar o que, al contrario, ellos nos hagan llorar a nosotros, o terminemos enamorándonos de sus circuitos, pero ¿y si un bandido al Bender style no está tan lejos?

Visto en: Paranoic bot.

Deja una respuesta